¿Qué pasa con las palabras que no se lleva el viento? - Segunda parte

M. Giménez Bautista / V. Penas | 03/11/2023

La tensión entre decir lo que pensamos y pensar en lo que decimos. Segunda parte.

En febrero se confirmó una sentencia judicial dictada en Formosa en la que se condenó un hecho de violencia contra las mujeres en el entorno digital. Esto puso en juego el ejercicio y el alcance de la libertad de expresión, a pesar de los consensos logrados para proteger este derecho. Lo cierto es que la criminalización del discurso en línea se sigue presentando como la opción más viable para una respuesta rápida frente a hechos de violencia de género en este ámbito. Ahora bien, ¿es posible tratar una problemática tan compleja apelando a la inmediatez en lugar de pensar a largo plazo? ¿Qué sentido tiene castigar el discurso de manera aislada sin detenerse en los factores que lo originan?

Este fallo le dio la razón a una funcionaria municipal de la capital provincial que había denunciado a un periodista por los comentarios ofensivos sobre su vida privada en una página pública de Facebook y respaldó la remoción del contenido ofensivo que la justicia le había ordenado al dueño del sitio. Como fue señalado en la primera parte de esta nota, los jueces demostraron su voluntad de tratar este tipo de violencia, pero la ausencia de una definición legal concreta les dejó poco margen para elaborar sus argumentos. Como suele ocurrir en los casos que la ley no contempla específicamente, la justicia debió explicar lo sucedido en base a los tipos de violencia ya reconocidos por la norma, para intentar llenar ese vacío.

El periodista cuestionó la sanción que se le había impuesto, entendiendo que representaba un abuso del accionar judicial, así como una amenaza a la labor periodística y a la libertad de expresión frente a la difusión de información de interés público, por tratarse del desempeño de una funcionaria. No obstante, la Cámara de Apelaciones entendió que el principal argumento utilizado por el dueño del sitio era el que más lo perjudicaba, dado que las expresiones publicadas en su página excedían de manera alevosa la esfera de la vida profesional de la funcionaria. En concreto, la Cámara se refirió al caso como un hecho de violencia mediática, buscando el término normativo más acertado para describir lo ocurrido.

Esta limitación no es un problema menor si se piensa en la consecuencia que debió afrontar el periodista denunciado. Frente a la creciente tensión entre el derecho de las mujeres a una vida sin violencia y el derecho a la libertad de expresión, la necesidad de definir el alcance de la violencia de género digital se ha vuelto indiscutible.

En octubre de este año, tras varios proyectos y debates parlamentarios, Argentina aprobó una modificación de la Ley N° 26.485 de Violencia contra las Mujeres que reconoce la violencia digital y contempla aquellas agresiones basadas en un sesgo de género que son cometidas mediante el uso de tecnologías. Una de las medidas de abordaje que la norma propone es la remoción del contenido dañino publicado en plataformas digitales, tal como había ordenado en su momento la justicia de Formosa al respecto de la violencia sufrida por la funcionaria municipal. En este escenario cabe preguntarse qué habría ocurrido si el caso se hubiera dado luego del surgimiento de este nuevo marco legal, y cómo se verá reflejada en futuras decisiones judiciales la facultad de restringir el discurso en línea frente a hechos de violencia de género digital.

En su informe sobre Violencia de Género Digital, la ADC se ha manifestado acerca de la importancia de pensar la normativa de cara a su implementación práctica. Entre los lineamientos más importantes, la organización propuso tener en cuenta la articulación de la ley con el desarrollo de políticas públicas eficaces y el balance de derechos fundamentales. En este sentido, la nueva ley refleja el consenso político logrado para tratar el problema, a la vez que plantea un desafío a futuro: el diseño de un abordaje integral basado en las características actuales de la violencia contra las mujeres, entendiendo al ámbito digital como una de sus dimensiones.

Si el objetivo final es prevenir y erradicar esta problemática, el tipo de abordaje elegido en este caso por la justicia de Formosa despierta algunos interrogantes: ¿es posible llegar a la raíz del problema con un enfoque punitivista y aislado, apelando solamente a una respuesta inmediata frente a casos concretos? ¿Qué otras estrategias se pueden pensar en términos de educación para terminar con la desigualdad estructural que esta violencia reproduce? Frente a la complejidad que ha adquirido la violencia de género en el contexto de la digitalización, el análisis del discurso en línea debe apostar a un balance de los derechos en juego, tomando como punto de partida una definición precisa del alcance del problema y de las afectaciones a derechos fundamentales que se desprenden del mismo. Solo así podrán considerarse legítimos los abordajes concretos, especialmente cuando estos tienden a poner en juego el ejercicio de otros derechos.

More

¿Alguna vez viste una noticia que luego resultó ser engañosa o a un medio desmentir información que publicó? Hoy en día, con el crecimiento exponencial de circulación de información en Internet, es cada vez más alta la probabilidad de que datos falsos lleguen a los medios de comunicación tradicionales. Si bien es cierto que las redes sociales son espacios en los que las personas pasan cada año más tiempo y su uso para fines informativos crece constantemente, los medios de comunicación tradicionales continúan teniendo un rol fundamental en proveer información a la ciudadanía. Esto nos lleva a reflexionar sobre el rol del periodismo, en la veracidad de la información que presentan y la necesidad de contar con fuentes confiables al momento de informarse.

A fines del 2022, en el programa El Pase del canal La Nación + se analizó un video de un acto del plenario de la Unión Obrera Metalúrgica (UOM) en el que la vicepresidenta Cristina Fernández estaba presente y las personas asistentes cantaban la consigna “vamos a volver”. Luego de verlo, los conductores opinaron que era incongruente pedir “que vuelva” al gobierno una dirigente que es parte de la administración actual y ocupa un rol institucional clave. El video, que fue publicado por el canal a partir de unos tweets virales, resultó ser engañoso ya que el audio estaba editado. Mediante un chequeo de fuentes se pudo corroborar que el audio original era otro.

En este caso, información extraída de las redes sociales llegó a la televisión sin un chequeo previo, generando así un efecto multiplicador de la desinformación. Si bien se menciona este caso como un ejemplo, es necesario estar alerta sobre este tipo de errores porque, en un contexto en el que abundan las imágenes creadas mediante inteligencia artificial y deepfakes, los desafíos de comunicar se multiplican.

Para dimensionar el impacto que mantienen los medios de comunicación en la forma en que las personas acceden a la información en nuestro país se puede consultar la Encuesta Nacional de Consumos Culturales que indica que el 91 por ciento de la población consume televisión de aire o cable, y el 83 por ciento lo hace de manera habitual. De los tipos de programas de TV, el 70 por ciento de las personas elige los informativos. Sobre noticias escritas, la lectura frecuente se registra sobre todo en redes sociales y diarios digitales.

Contrastar las fuentes con regularidad y corroborar la veracidad de la información es una parte fundamental de la labor periodística, pero al mismo tiempo es una actividad que requiere que se le destine gran cantidad de recursos, siendo el más importante de ellos el tiempo. La novedad y la necesidad de publicar una noticia “antes que nadie” son moneda corriente en el rubro y por eso los riesgos de darle exposición a un contenido falso se multiplican.

Los desafíos de la actualidad generaron el surgimiento de un nuevo actor: las organizaciones que se dedican a desmentir contenido engañoso y a ampliar el contexto de determinadas noticias. Los fact checkers trabajan en muchos países y se encargan de salvaguardar el derecho al acceso a la información de calidad, adaptando su labor al contexto en el que están. En Argentina la organización Chequeado dobla esfuerzos en períodos electorales para resguardar el derecho al voto informado de la población.

Salvaguardar el debate democrático tiene que ser el principal objetivo del periodismo en todo momento, pero sobre todo en épocas electorales, por este motivo es necesario contar con una “caja de herramientas” que incluya medios de confianza, seguir a profesionales del fact checking y buscar información alternativa si algo genera dudas, tal como indica nuestro informe de buenas prácticas.

More

En la actualidad es claro que la participación en la vida pública no está limitada al espacio físico sino que el espacio digital se convierte también en un entorno que permite un ejercicio activo de la ciudadanía. Sin embargo, la confusión generalizada que puede generar un deep fake y las grandes cantidades de desinformación que circulan afectan la posibilidad de ejercer esa ciudadanía en internet. Tanto las personas que son protagonistas de las falsificaciones creadas mediante inteligencia artificial como aquellas que comparten esa información errónea son afectadas por un contexto que disminuye sus capacidades para generar un debate informado y que genera cada vez más desconfianza y confusión.

Según medios estadounidenses, las elecciones presidenciales de 2024 serían las primeras en estar repletas de desinformación creada con inteligencia artificial, por lo que se teme que el límite entre realidad y ficción se vuelva difuso y difícil de distinguir para las personas de a pie. Sin ir más lejos, aunque falte más de un año para el inicio de campaña, ya aparecieron los primeros engaños utilizando inteligencia artificial en imágenes, creando deep fakes y falsificaciones de voz.

En las internas estadounidenses ya comenzó la disputa y se dió a conocer un anuncio que incluye un montaje de Donald Trump muy cercano a uno de sus mayores opositores, Anthony Fauci. Estas imágenes, que son parte de la campaña de Ron DeSantis quién ya lanzó su candidatura a la presidencia, tiene la clara intención de desacreditar al ex presidente mostrando una supuesta falta de coherencia. Lo que llama la atención de este anuncio es la forma en la que presenta la información: mezclando imágenes reales con otras creadas por una inteligencia artificial.

Por otro lado, en su red social Truth Social, Trump publicó un video en el que recrea el lanzamiento de campaña que DeSantis realizó mediante Twitter Spaces, burlándose de los inconvenientes técnicos que ocurrieron. En la parodia se usó inteligencia artificial para simular las voces de personas invitadas al lanzamiento de campaña de DeSantis, entre quienes se encontraban George Soros, Adolf Hitler y hasta “el diablo”.

Tanto DeSantis como Trump son competidores para un rol de alta exposición y conocen las reglas del juego. Sin embargo, las falsificaciones no se limitan a su partido y en un entorno competitivo hay un impacto negativo cuando se acusa falsamente a una candidata o candidato, o se pone en duda su credibilidad. Al mismo tiempo, del otro lado de estas campañas de comunicación se encuentran las personas que también participan de este sistema, consumiendo el contenido y/o compartiéndolo.

Quienes comparten contenido falso no logran acceder a información de calidad y replican información dañina. Al mismo tiempo, quienes consumen el contenido deben invertir cada vez más tiempo para informarse. La necesidad de chequear en varios medios si una noticia es real o no es una práctica aconsejable en cualquier contexto, sin embargo, es poco realista pensar que todas las personas cuentan con el tiempo suficiente para hacerlo a diario.

Del lado de las empresas, podemos notar que en contextos electorales la autorregulación de las plataformas generadoras de imágenes no es suficiente, tal como se amplió en una nota anterior. En la mayoría de los casos no alcanza con la prohibición de generar imágenes de boletas partidarias o urnas, ya que cualquier imágen pueda llegar a tener un significado político, tal es el caso de Fauci mencionado más arriba.

Con la extensión de estas prácticas se degrada cada vez más el espacio cívico al no lograr unas pautas comunes en el debate en internet. ¿Cómo podemos ejercer el derecho al acceso a la información cuando tememos que toda la información que nos rodea sea posiblemente falsa? En este año electoral, pero sobre todo, para los que siguen, estos elementos serán centrales para pensar a internet como un lugar donde ejercer la ciudadanía.

More

Suele decirse que la irrupción de lo digital ha creado un ambiente más democratizado y participativo en la sociedad en general, y en su interacción con el Estado y sus representantes en particular. Las redes sociales son un claro signo de ello y su uso por parte de funcionarios públicos y organismos estatales es moneda corriente. Es muy común que las utilicen para brindar información de gestión, opiniones políticas y medidas gubernamentales, y, en algunos casos, para interactuar con la ciudadanía. Los organismos y dependencias estatales muchas veces lo hacen para informar medidas, servicios y/o responder consultas, es decir para el ejercicio de sus funciones de gobierno.

Estas interacciones en las plataformas traen aparejados ciertos conflictos y tensiones que, aunque ya existían en el mundo analógico, se intensifican y adquieren más permanencia y estado público en el entorno digital. Por ejemplo, si antes una persona iba a la AFIP personalmente y se encontraba atrapada en un bucle de burocracia institucional, era posible que se generara una discusión con la o el funcionarios de guardia. En este caso el conflicto se reducía solamente a ese momento y a esa dependencia física. Sin embargo, en la arena digital los conflictos adquieren más permanencia y los niveles de agresión más intensidad. Esto se debe a que los comentarios o mensajes quedan escritos y otros usuarios y usuarias suman sus quejas y/o apoyo, que muchas veces son anónimos.

En el caso de las figuras políticas las tensiones son mayores, cuantitativamente y cualitativamente, ya que las interacciones no sólo abarcan reclamos y pedidos, sino también agresiones por cuestiones ideológicas, políticas y de género, entre otras. Ante esta situación, muchas y muchos de las y los titulares de las cuentas en redes sociales toman la resolución de bloquear a determinados usuarios, prohibir los comentarios o poner sus cuentas en modo privado. Lo que se persigue es evitar conflictos o que en sus posteos figuren discursos disidentes.

A primera vista, podemos ver la tensión con respecto a ciertos temas que desde la ADC vienen trabajando. Por un lado, la libertad de expresión y, por el otro, la disyuntiva regulatoria sobre discursos de odio. Este último es un tema complejo que genera controversias. Por un lado, internet es terreno fértil para la viralización de mensajes denigrantes y agresivos contra grupos o personas en situación de vulnerabilidad o con mayor exposición. Por el otro, esta situación se ha utilizado para justificar intentos de restricción ilegítimas a la libertad de expresión.

Esto nos hace pensar en el siguiente interrogante: ¿es correcto que un funcionario público u organismo estatal restrinja el acceso y la participación en sus redes sociales?

En el caso de personas que se dedican a la función pública y organismos estatales hay una dimensión que se debe considerar: la utilización de estas plataformas para el ejercicio de funciones de gobierno o de servicios públicos. Ello implica considerar que el bloqueo de usuarios y usuarias, o comentarios puede traer aparejado el incumplimiento de ciertos aspectos obligatorios en el ejercicio de la función pública.

Si una funcionaria o funcionario bloquea a otros en cuentas que comunican medidas, resoluciones y/o políticas de gobierno estaría restringiendo el acceso a ese tipo de información, que por principio general es pública. Es cierto que muchas de esas medidas luego son publicadas en boletines oficiales u otros medios, pero esta situación podría asemejarse a que se bloquee la señal de radio y televisión a parte de la ciudadanía durante la cadena nacional.

En el caso de los organismos estatales que prestan servicios públicos, la situación resulta mucho más contundente: bloquear usuarios implicaría restringir el acceso a ciertos servicios que se brindan a través de redes sociales. Aquí se debe considerar que en general los organismos públicos no lo hacen, pero existen casos de cuentas de organismo que sé se involucran a un nivel más “humano”. Un ejemplo de esto último puede ser la cuenta de Twitter oficial de la Casa Rosada, que, durante la presidencia de Cristina Fernández del 2011 al 2015, publicaba contenido partidario y en contra del partido opositor además de la información oficial.

Ahora bien, ¿esto implicaría que funcionarias y funcionarios tengan que soportar todo tipo de agresiones por redes sociales? Aunque este debate se viene llevando hace un tiempo, en el plano jurisprudencial argentino no hay ninguna sentencia al respecto. En cambio en Estados Unidos en el 2019 una corte federal de apelación resolvió que Donald Trump, en ese momento presidente, no podía bloquear usuarios en Twitter por sus diferencias políticas.

Los fundamentos de esta sentencia se centraron en que «la Primera Enmienda no permite que un funcionario público que utiliza una cuenta de redes sociales para todo tipo de propósitos oficiales excluya a personas de un diálogo en línea, de otra forma abierto, porque expresaron opiniones con las que el funcionario no está de acuerdo». Según la resolución del tribunal estadounidense el quid de la cuestión radica en el criterio de decisión que se esté tomando para bloquear usuarios y el tipo de uso que esté haciendo la figura pública de la cuenta -oficial o no oficial-.

En consecuencia, y como primera aproximación al tema, podríamos decir que en los casos en que los organismos y representantes del Estado utilicen sus redes sociales para cuestiones oficiales, soportar hostilidades, ofensas y molestias es parte de lo que trae aparejado el ejercicio de la función pública. Ante esta situación, y teniendo en cuenta ciertos casos en Argentina en dónde el tono de las interacciones con representantes de la función pública a través de redes sociales fueron investigadas por la Justicia por la posibilidad de la configuración de los delitos de amenazas e intimidación pública, nuestro sistema aún tiene una clara tensión que resolver.

More

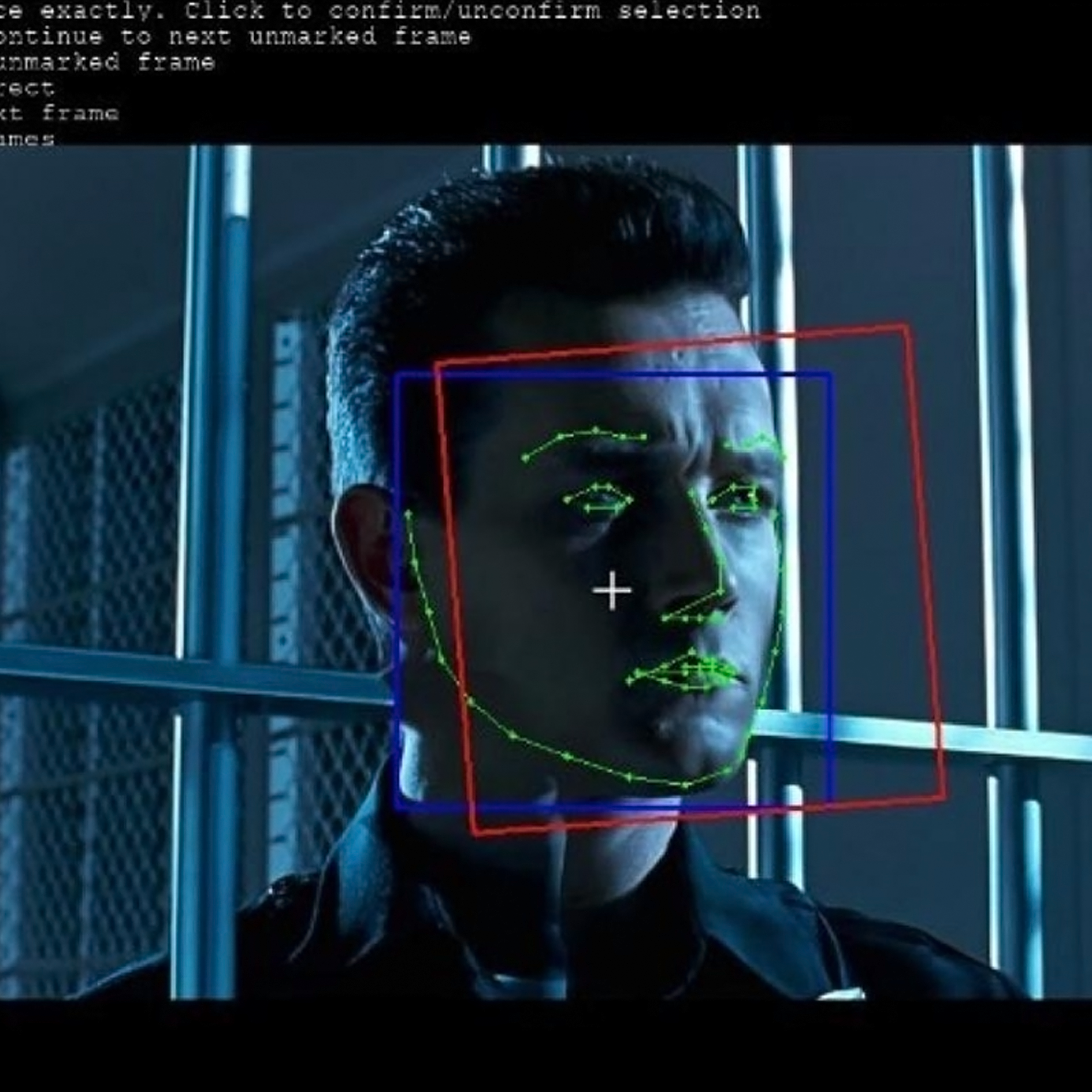

A partir de la aparición de los primeros deep fakes sobre cuestiones políticas, los medios y sectores académicos señalaron el alto potencial que este tipo de contenido tiene para difundir desinformación en internet. Las redes sociales son un lugar en el que las personas entran a distenderse y contactar con otros, pero cada vez más se convierten en una fuente de información confiable. Un 35,8 por ciento indica que las usa para estar al tanto de las noticias y, a su vez, el tiempo de uso aumenta cada año. En Argentina el promedio diario es de 3 horas y 15 minutos (un aumento de 11 minutos en relación con 2022). Por este motivo es que se torna central conocer qué medidas toman las plataformas con respecto a la difusión de deep fakes con fines de desinformación. ¿Es posible denunciar un deep fake? ¿Las plataformas eliminan estos contenidos? ¿Cómo definen si un video es deep fake o no? ¿Qué sucede cuando el uso de un deepfake no está hecho para engañar sino con fines de sátira política?

Las grandes crisis son terreno propicio para la aparición de desinformación, por eso desde el inicio del conflicto bélico entre Rusia y Ucrania se multiplicaron los contenidos engañosos. En marzo del año pasado apareció un video en Facebook y Youtube en el que el presidente ucraniano Volodymyr Zelensky anunciaba su rendición ante Rusia y pedía a los soldados que depusieran las armas. El clip se replicó también en el sitio web del canal de televisión Ucrania 24, lo que masificó su alcance. Pocos minutos después, el mismo Zelensky publicó un video en Facebook denunciando que el contenido era falso, lo que llevó a una respuesta inmediata de la plataforma. Nathaniel Gleicher, jefe de política de seguridad de la empresa, publicó en Twitter un comunicado donde explicaba que el video había sido eliminado por incumplir su política sobre vídeos manipulados con fines engañosos.

En este caso, el alto perfil público del presidente ucraniano y la rápida respuesta tanto del gobierno como de los medios y plataformas de redes sociales permitieron que el engaño no se difunda, frenando las consecuencias a nivel bélico. A esto se suma el hecho de que el deep fake no era de buena calidad, por lo que fue cuestionado por las usuarias y usuarios rápidamente.

Como se mencionó anteriormente, Facebook dispone de una política contra la publicación de videos manipulados. Estas medidas tienen diferentes niveles de penalización. Si la publicación infringe las normas comunitarias (sea porque incluyen desnudez, violencia gráfica, supresión de votantes y/o incitación al odio) se elimina. Si no infringe las normas, la publicación es revisada por fact checkers que definen si se trata de contenido engañoso o no. Además, se reduce el alcance de la publicación y se incluye una advertencia sobre la veracidad del mismo.

Otras plataformas cuentan con políticas similares para frenar la difusión de deep fakes. Twitter elimina tweets si considera que hay peligro grave de dañar a personas o comunidades, si no es así puede agregar una etiqueta proporcionando contexto para que las personas tengan más información al definir si lo que están viendo es auténtico o falso. Las pautas de Youtube indican que el contenido engañoso, incluidos los deep fakes, no está permitido en la plataforma. En este caso aclaran que para detectarlos utilizan una combinación de revisores de contenido y aprendizaje automático, de forma tal que puedan eliminarlos rápidamente. En Tik Tok, las políticas indican que al publicar contenido generado con una IA se deben agregar términos que lo expliciten (“sintético”, “falso”, “no real” o “alterado”). El contenido impreciso o engañoso pasa por revisores independientes, es eliminado de la sección “para ti” y se sugiere a las personas usuarias que reconsideren si desean compartirlo.

El análisis de las políticas vigentes en las plataformas abre algunos interrogantes. No queda claro cómo las plataformas advierten que un contenido es una falsificación creada mediante IA. Tampoco indican si utilizan alguna de ellas para detectarlos o si lo hacen mediante denuncias de las personas usuarias. Por otro lado, en ninguna de estas plataformas hay un mecanismo directo para denunciar que un video es deep fake, por lo que debe hacerse en forma general como contenido poco preciso o engañoso retrasando posiblemente la aplicación de medidas que frenen su viralización. En Facebook y Twitter podemos encontrar una distinción sobre el contenido creado con fines de sátira o parodia ya que indican que estos no serían eliminados. Sin embargo, no mencionan la forma en la que distinguen si el fin es el hacer una crítica o si se publicó con el fin de desinformar. Esta falta de información en las políticas podría llevar a que sean removidos contenidos legítimos, generando un exceso de moderación perjudicial a la libertad de expresión.

Al mismo tiempo, el modo en el que las plataformas aplican sus políticas es desigual en muchos casos. Actualmente se pueden encontrar deep fakes en Twitter sin una etiqueta que aporte contexto, mientras que también hay casos de imágenes creadas por IA que fueron intervenidas por la plataforma (aclarando que fueron creadas mediante un software).

La disparidad al momento de implementar normas afecta a la transparencia de los procesos y muestra a las claras los problemas de la autorregulación. En el caso de Zelensky hubo un accionar eficaz que permitió frenar el engaño a tiempo, pero no conocemos si la misma suerte correrá en el caso de difusión de videos falsos sobre figuras menos conocidas.

La multiplicación de contenido engañoso circulando en redes sociales es un problema en el momento actual en el que cada vez más personas acceden a las plataformas para informarse. En estos casos, la moderación de contenidos puede ser una medida útil para frenar el alcance del contenido falso. Sin embargo, es importante que las normas se apliquen por igual a cada post, independientemente si se trata de publicaciones virales o no. Sólo de esta forma la moderación será efectiva para salvaguardar el derecho de acceso a la información de todas las personas por igual.

More

A partir del lanzamiento de ChatGPT y el gran impacto que tuvo en internet, muchas empresas proveedoras de inteligencias artificiales salieron al mercado a competir por la atención de los usuarios. Tanto es así que actualmente podemos encontrar una IA para casi todo: desgrabar audios, crear guiones, resolver problemas matemáticos e incluso crear imágenes totalmente realistas. Herramientas como Dall-e, Stable Diffusion o Midjourney son muy útiles pero también pueden ser peligrosas si se usan para generar confusión o desinformar. A partir de la aparición de IAs la forma en la que la información se produce y difunde cambió radicalmente, por lo que es momento de preguntarse: ¿Las empresas conocen los efectos que tendrá la introducción de las IA en la difusión de desinformación? ¿Qué sucede con el derecho al acceso a la información de calidad?

Durante las últimas semanas circularon por redes sociales unas fotos del Papa Francisco que llamaron mucho la atención. En ellas se lo podía ver vistiendo un abrigo Balenciaga pero con un estilo similar a su tradicional sotana. Ante el desconcierto generalizado, usuarios y usuarias trataron de buscar respuestas analizando la imágen y navegando en diferentes portales. Incluso algunas personas aconsejaron “hacer zoom a las manos” porque generalmente las inteligencias artificiales suelen fallar al crear partes del cuerpo más complejas. Pero esas recomendaciones que pudieron ser útiles meses atrás ya no lo son, el salto exponencial en la calidad de las imágenes que generan las inteligencias artificiales en la actualidad es tan grande que pueden ser difíciles de detectar hasta para un ojo experto. Después de unas horas de desconcierto y debate se conoció que las imágenes eran falsas.

Las empresas desarrolladoras de IAs generadoras de imágenes cuentan con normas de uso para limitar los efectos negativos de sus creaciones pero, ¿es suficiente? En el caso de Dall-e, la plataforma prohíbe el uso político de sus productos. Por este motivo es que no genera imágenes en contextos electorales (urnas o boletas) ni tampoco imágenes alusivas a protestas o figuras políticas. El caso contrario es el de Midjourney, que tiene unas políticas mucho más laxas y prohíbe únicamente imágenes de contenido para adultos o gore. Esta diferencia en las normas de uso es problemática al momento de pensar en la responsabilidad de las empresas sobre los productos que crean. ¿Es suficiente poner unas normas de uso genéricas sin considerar todos los usos posibles de una IA? En una época signada por la rapidez en la que se difunde la información, con poco espacio para la doble verificación sería realmente beneficioso contar con reglas claras basadas en un acuerdo básico: la desinformación afecta la calidad del debate democrático y es responsabilidad de todos limitar sus efectos.

Recientemente ocurrió otro hecho que tuvo a Midjourney como protagonista, se trata de la aparición de fotos de Donald Trump siendo arrestado que generaron alarma entre sus partidarios. Actualmente el ex mandatario está atravesando un proceso legal y, fiel a su estilo, escribió en su red social Truth Social que estaba seguro de que su arresto ocurriría pronto. En el mismo posteo convocó a sus lectores a protestar para “recuperar la nación”. A partir de este acontecimiento, un usuario de Twitter le pidió a esta IA que ilustre el suceso y publicó el resultado, que se volvió viral. Algunos perfiles con mayor alcance replicaron las fotos y generaron desconcierto entre quienes querían organizarse para defenderlo y quienes dudaban sobre si el hecho era verdadero o falso.

Tanto las fotos del papa como las de Donald Trump son ejemplos claros de la capacidad que tienen las IAs para generar confusión con tan solo pedirle que represente una situación que resulte apenas verosímil. En ambos casos las imágenes ilustraron hechos que podrían tener lugar en la realidad, lo que complejiza aún más distinguir cuándo un contenido es verídico. En determinados contextos la desinformación toma fuerza y se propaga mucho más rápido y, si sumamos el componente de que todo el mundo tiene a la mano una herramienta para generar imágenes a demanda, los riesgos de la desinformación se multiplican exponencialmente.

Por el momento las medidas implementadas por las empresas son sectorizadas e insuficientes. Midjourney, a partir de la viralización de las imágenes del Papa y de Donald Trump, decidió eliminar la prueba gratuita que permitía a las personas crear hasta 25 imágenes libres. Actualmente para utilizar esta herramienta es necesario pagar una suscripción mensual. Al mismo tiempo, varios CEOs de compañías tecnológicas firmaron una carta en la que pidieron frenar por seis meses los entrenamientos de las IAs más potentes porque no se conocen aún los riesgos e implicancias para la sociedad.

Los sucesos recientes son una señal de alerta pero también indican que es un buen momento para reflexionar sobre el futuro que queremos y entablar un diálogo entre empresas, Estados y sociedad civil de forma que sea posible alinear la actividad privada con el pleno ejercicio de los derechos humanos y pensar en un desarrollo de herramientas que no colisione con el acceso a la información de calidad.

Un futuro en el que internet esté inundado de datos erróneos y sea difícil confiar en las fuentes de información es una posibilidad real. Lo que está en juego son los acuerdos que sostienen el sistema de información y, por este motivo, las respuestas desde las empresas tienen que surgir de un debate consensuado que incluya a toda la ciudadanía y a nuestros representantes.

More

Desde su despegue en la década de los noventa a la actualidad, la inteligencia artificial (IA) se ha convertido en una herramienta con una significativa presencia en la vida cotidiana, con aplicaciones que van desde la atención médica hasta las inversiones y finanzas. Sin embargo, a medida que la IA se vuelve más sofisticada, también se va haciendo evidente que está distante de ser neutral, reproduciendo o amplificando los prejuicios y sesgos presentes en la sociedad como, por ejemplo, el racismo y la discriminación.

A pesar de los avances en la tecnología de IA, los sistemas automatizados a menudo muestran sesgos raciales alarmantes. Por caso, la herramienta ChatGPT – que desde su nacimiento hace cuatro meses lleva cosechados más de 100 millones de usuarios únicos- se ha comprobado que es capaz de presentar en ocasiones resultados sexistas, raciales o intolerantes. Esto obedece en parte a que los algoritmos de IA son entrenados empleando grandes volúmenes de información histórica, que muchas veces reflejan sesgos y discriminación presentes en la sociedad. Ha habido reportes de usuarios de ChatGTP que señalan casos en los que cuando al bot se le solicitaba que escriba, en función de sexo y raza, un código para evaluar si alguien podría ser un buen científico, el bot sugería solo hombres blancos. “Si se están entrenando modelos con datos que reflejan prejuicios sociales y contenido tóxico, será difícil evitar que ese contenido aprendido se filtre”, reflexionó en una nota de la revista Motherboard, semanas atrás, Yacine Jernite, responsable de Aprendizaje Automático y Sociedad de la comunidad de AI Hugging Face.

Al mismo tiempo, la escasez de diversidad en el desarrollo y entrenamiento de los sistemas de IA también contribuye a los sesgos raciales. Los equipos de desarrollo de tecnología en ocasiones carecen de representación de grupos minoritarios, lo que lleva a la falta de perspectivas y experiencias diversas en la creación de estos sistemas.

Como resultado, los algoritmos pueden exhibir sesgos implícitos que perpetúan la discriminación racial. Por ejemplo, se han registrado casos en el que los usados en la contratación de personal, la evaluación crediticia y la justicia penal han estado bajo la lupa por mostrar sesgos raciales y, colaborar así, a la discriminación sistemática de algunas minorías.

Ante este panorama, con una dinámica impensada, de escenarios próximos aún tampoco contemplados siquiera en las teorías más avanzadas sobre el tema, se convierte en materia urgente el no perder de vista el aspecto del racismo y discriminación en la tecnología artificial. Entre algunas de las recomendaciones sobre la materia, se encuentran:

● Aumentar la diversidad en el desarrollo de IA: es fundamental garantizar y promover que los equipos de desarrolladores y desarrolladoras de IA sean diversos y representativos de la sociedad, incorporando personas de distintos orígenes étnicos y culturales. Esto colaboraría a detectar y abordar sesgos implícitos en la creación de algoritmos, y asegurar que se contemplen múltiples perspectivas en la creación de sistemas de inteligencia artificial.

● Evaluaciones de sesgos: los algoritmos de IA deben ser sometidos a auditorías y pruebas rigurosas para identificar posibles sesgos raciales y discriminatorios. Es decir, revisar y analizar la calidad de los datos de entrenamientos utilizados, así como seguir al detalle la performance de los sistemas en casos reales para identificar y abordar sesgos emergentes.

● Transparencia y responsabilidad: las organizaciones que desarrollan y emplean sistemas de IA tienen que ser transparentes en su funcionamiento e informar cualquier sesgo detectado y las mitigaciones implementadas para abordarlo. Además, deben responsabilizarse de corregir los sesgos en sus sistemas y rendir cuentas por cualquier discriminación ejecutada por la IA.

● Concientización: Es central informar y educar a los desarrolladores de IA, a los profesionales del sector tecnológico y al público en general sobre los eventuales sesgos raciales en la IA y su impacto en la sociedad.

● Regulación y políticas: Es preciso buscar una regulación basada en estándares de derechos humanos.

“No podemos seguir reaccionando tardíamente a los efectos de la IA, ni permitir que se use de manera ilimitada, sin fronteras ni supervisión, para enfrentarnos luego a sus casi inevitables consecuencias sobre los derechos humanos. La capacidad de la IA para servir a la población es innegable, pero también lo es su capacidad de contribuir a violaciones de derechos humanos en gran escala, de manera casi indetectable. Es necesario adoptar urgentemente medidas para imponer límites basados en los derechos humanos a la utilización de la IA por el bien de todos”, señaló en 2021 la por entonces Alta Comisionada Michelle Bachelet.

Es preciso discutir sobre eventuales regulaciones en pos de implementar políticas públicas claras que contemplen especialmente el aspecto del racismo y la discriminación en la IA, determinando, por ejemplo, mecanismos de supervisión y control que garanticen la equidad en el desarrollo y uso de la inteligencia artificial.

En síntesis, la discriminación racial en la IA es una problemática que demanda especial atención, considerando que los sesgos en los sistemas de IA pueden perpetuar la exclusión de ciertos grupos raciales, lo que resulta en mayor desigualdad en diversos ámbitos de la sociedad. Una disparidad que alarma a intelectuales como el escritor e historiador israelí Yuval Noah Harari, quien junto con Tristan Harris y Aza Raskin, con ojo atento a los peligros de la tecnología IA, se preguntaban en un reciente artículo conjunto: “¿Qué significaría para nosotros vivir en un mundo donde gran porcentaje de las historias, melodías, imágenes, leyes, políticas y herramientas fueron moldeadas por una inteligencia no humana, que sabe cómo explotar con eficiencia sobrehumana todas las debilidades, los sesgos y las adicciones de los seres humanos, con quienes además sabe establecer relaciones íntimas? En juegos como el ajedrez, por ejemplo, ningún ser humano puede aspirar a vencer a una computadora. ¿Y si pasara lo mismo en el arte, la política o la religión?”.

¿Querés conocer el trabajo de la Asociación por los Derechos Civiles (ADC) en materia de análisis y debate acerca de la inteligencia artificial? Hacé clic acá y lee las notas sobre el tema en nuestra web.

More

En 2018 apareció un video en el que se podía ver a Barack Obama insultando a Donald Trump. Segundos después se mostraba que no había sido el ex presidente estadounidense sino que se trataba del actor Jordan Peele que se hacía pasar por él de manera hiperrealista. Este video publicado en el canal de Youtube de Buzzfeed es conocido como uno de los primeros en usar un deep fake con figuras políticas, con el buscan demostrar que se está dando un cambio en la forma en la que fluye la información y que es necesario estar alertas, ya que no todo lo que se ve en Internet es real.

Los deep fakes son videos creados o modificados mediante un software que, aplicando técnicas de deep learning, permiten crear imágenes falsas de forma realista. Si bien existen otras formas de manipulación de video, tales como la edición que incluye cortes de imagen, distorsión en la velocidad y cambios en el audio, sólo puede llamarse así a aquellos creados mediante softwares.

Los usos que se le dan a los deep fakes son múltiples, algunos más riesgosos que otros. Es posible encontrar contenido que entra en la categoría de entretenimiento y humor, tal es el caso de cuentas en redes sociales como @deepfakesar en la que se publican videos de este tipo sobre celebridades. Otros usos posibles, y menos inocentes, tienen que ver con la propagación de desinformación que pueden acarrear consecuencias políticas y también afectar el pleno ejercicio de derechos de la ciudadanía.

Este tipo de videos afecta la calidad de la información que circula en internet, pero sus efectos perniciosos se extienden mucho más allá. Un entorno en el que no se puede distinguir lo real de lo falso genera una pérdida de confianza en las instituciones y en Argentina se trata de un problema que preocupa a la población. Según la encuesta Edelman Trust Barometer del 2022, un estudio representativo de 28 países que se realiza hace más de 20 años, ante la afirmación “me preocupa que la información falsa o las noticias falsas sean utilizadas como arma” el 76 por ciento de los encuestados a nivel global dice estar de acuerdo. Si miramos solamente las respuestas de Argentina, ese porcentaje asciende a un 81 por ciento.

Los deep fakes además puede usarse para interferir en las campañas electorales y permitir la difusión de ataques personales y discusiones que son secundarias en relación a los temas que deben tratarse en campaña: las políticas que le importan a la ciudadanía. No son desdeñables los efectos a nivel personal que tienen este tipo de campañas de desinformación. Fueron sonados los casos de Nancy Pelosi, presidenta de la Cámara de Representantes de Estados Unidos, y de Patricia Bullrich, ex Ministra de Seguridad de Argentina. Ambas figuras sufrieron intentos de desprestigio de su imagen personal a partir de la difusión de videos alterados en los que parecían estar bajo los efectos del alcohol. Esto llevó a que se hable en los medios sobre su vida personal y no sobre las políticas que estaban impulsando en esos momentos.

Además de los efectos en la imagen pública de funcionarias y funcionarios, los deep fakes pueden generar alteraciones en la opinión pública. Las campañas de desinformación pueden utilizarse para afectar la imágen que la ciudadanía tiene de un partido o gobierno, o para mejorar la opinión que la ciudadanía tiene del mismo. Un caso reciente se dio cuando aparecieron vídeos como publicidad en Youtube en el que presentadores creados mediante un software daban noticias positivas (aunque poco precisas) sobre la economía en Venezuela, para promover una opinión favorable al gobierno.

Todos estos efectos conllevan también un riesgo importante, que es el aumento de la polarización política. Si bien un video puede ser desmentido, este tipo de contenido no se difunde en un contexto aislado. Debido a la lógica algorítmica de las redes sociales, es probable que un deep fake llegue a personas que tienen un esquema de pensamiento afín a ese contenido y, por ende, no cuestionen la veracidad del video. La microsegmentación, por un lado, y el efecto “cámara de eco”, por el otro, posibilitan que el contenido de desinformación circule por internet y se multiplique por cuentas que comparten y difunden, de manera casi invisible para aquellos que no siguen dichas cuentas.

En tiempos de campañas electorales como el que tendremos este año en Argentina, los contenidos engañosos representan un peligro mayor porque puede afectar a la confianza en el proceso electoral, lo que a su vez puede generar cuestionamientos a los resultados electorales. Si los ciudadanos y ciudadanas no confían en que se están haciendo esfuerzos para cuidar la integridad de los resultados electorales se pueden desatar manifestaciones y ataques directos a la democracia.

More

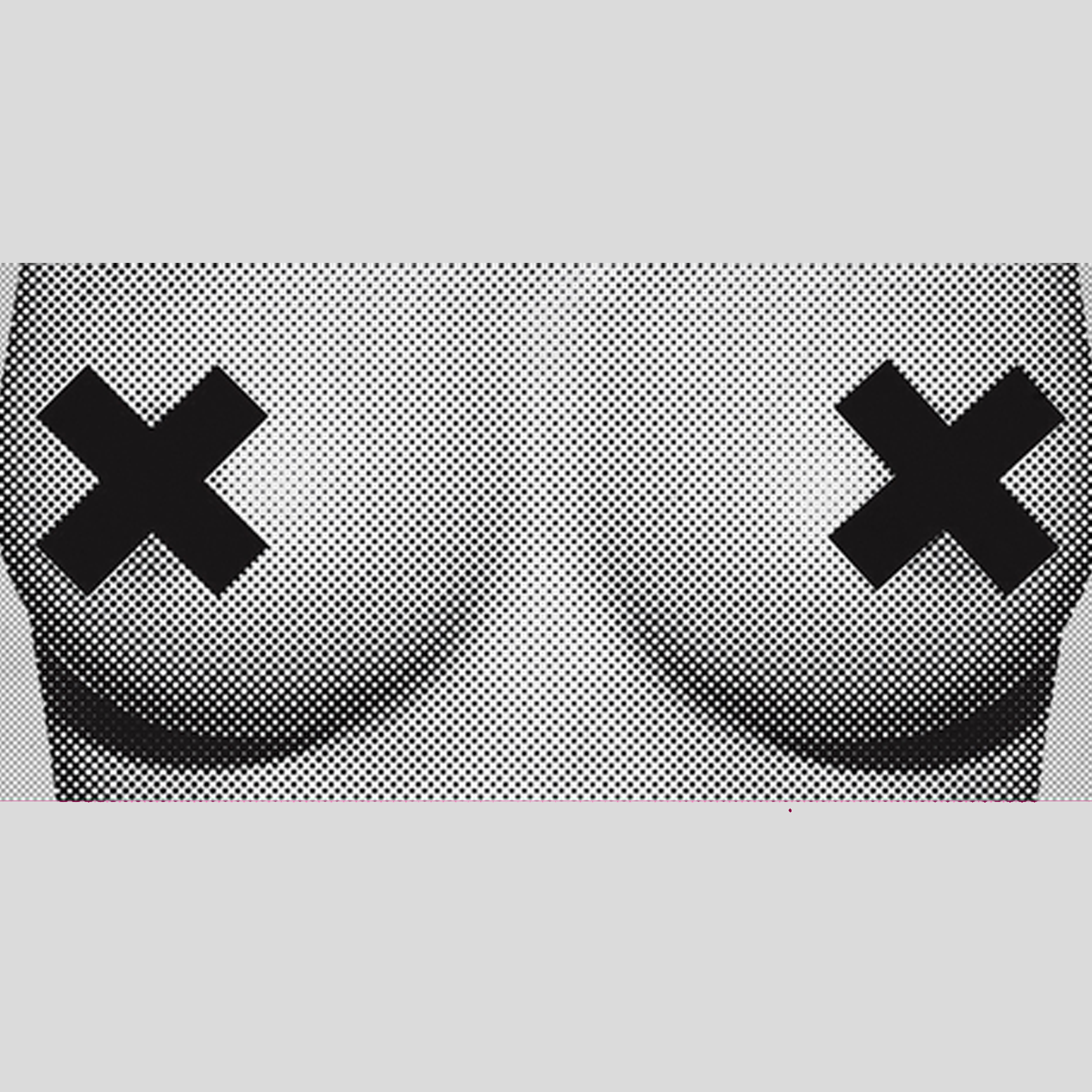

Con el paso del tiempo, las redes sociales han adquirido un papel fundamental en la difusión de información, en la manera en que percibimos al mundo y a las personas que nos rodean. Sin embargo, también han sido el escenario de prácticas de censura que atentan contra la libertad de expresión y la diversidad.

Uno de los ejemplos más claros es la prohibición de los pezones por parte de la red social Instagram. Es importante aclarar que esta política no es universal y que existen ciertas excepciones en las que se permite su visualización, como por ejemplo la lactancia materna. Así mismo hay que resaltar que no suele cumplirse esta salvedad y el contenido es usualmente restringido.

Aunque esta medida se justifica en nombre de la “decencia” y la “seguridad”, la realidad es que esta política representa una grave violación de los derechos civiles en línea. ¿Es el cuerpo humano algo que debe ser censurado? Y si es así, ¿quién decide qué partes son aceptables y cuáles no?

¿Censura o protección?

Instagram ha sido tema de discusión y debate entre activistas y organizaciones de la sociedad civil por sus controversiales políticas de censura corporal, más específicamente con los pezones femeninos. En la actualidad son considerados como “contenido inapropiado” y su exhibición es restringida o incluso eliminada de la plataforma, no siempre, pero suele suceder. Esta práctica discriminatoria y sexista, atenta contra el derecho a la igualdad y la diversidad en los entornos digitales.

La actriz y activista Scout Willis ha sido una de las figuras más destacadas en la lucha contra la censura de los pezones en la plataforma. En 2014, Willis publicó una fotografía en Instagram en la que aparecía caminando por las calles de New York sin camisa. La imagen fue eliminada, lo que llevó a la influencer a iniciar una campaña para concientizar sobre la discriminación que sufrían las mujeres en los espacios virtuales. En una carta abierta afirmó: “La censura de los pezones es una forma de violencia contra las mujeres, que perpetúa los estereotipos de género y limita la libertad de expresión”.

Sin ir más lejos, en 2019, la fotógrafa chilena Marcela Cerda publicó una serie de fotografías de mujeres amamantando, en el marco de una exposición llamada “Lactancia Libre”. Sin embargo, la plataforma eliminó varias de las imágenes por mostrar pezones femeninos, aunque estos eran utilizados en un contexto de militancia por el acceso a la salud pública y con fines educativos. De una forma directa o indirecta, estos ideales perpetúan la idea de que el cuerpo femenino es “inapropiado” y “vergonzoso”, algo que debe ser ocultado.

Esta clase de política empresarial puede parecer trivial para algunas personas, pero para muchas otras tiene un impacto real y negativo en su vida cotidiana, evidencia la necesidad de que las redes sociales ajusten sus normas a un contexto y realidad de cuerpos diversos que existen en la sociedad.

Educación y transparencia: claves para garantizar los derechos humanos en línea

Es de suma importancia destacar la relevancia de la educación y concientización en torno a la libertad de expresión y los derechos humanos en línea. La persistencia de estereotipos alrededor de la sexualidad y el cuerpo humano es uno de los principales motivos detrás de las políticas de censura discriminatorias que vemos en las redes sociales. Por ello, es fundamental trabajar en la desnaturalización de estos prejuicios, respetar las diferencias culturales, éticas, de género y de orientación sexual, entre otras, y fomentar una cultura de respeto y tolerancia.

Asimismo, es necesario que estas normas sean transparentes y consistentes, buscando mecanismos de apelación para los usuarios que sienten que sus derechos han sido vulnerados.

La lucha por la libertad de expresión es un desafío colectivo y requiere de la colaboración y compromiso de diferentes actores, incluyendo a las empresas, la sociedad civil y los propios consumidores de las plataformas digitales. Solo así podremos construir una sociedad más justa y equitativa en línea y fuera de ella.

¿Por qué nos interesa?

Esto es solo la punta del iceberg en un problema más grande. Es importante seguir impulsando a las empresas a reforzar el compromiso con la protección de los derechos humanos en los entornos digitales. Debemos recordar que la tecnología y las redes sociales han transformado la forma en que nos comunicamos y accedemos a la información, y con ello, han surgido nuevos desafíos que deben ser abordados de manera efectiva.

Velar por los derechos humanos no debe ser un compromiso opcional.

More

¿Qué pasa cuando las redes sociales median la conversación entre la política y la ciudadanía?

Uno de los secretos políticos mejor guardados en los últimos años fue el anuncio de la candidatura Alberto Fernández-Cristina Fernández para las elecciones 2019. Así, de un día para el otro y sin información filtrada, la entonces ex presidenta anunciaba por Twitter y YouTube el lanzamiento de la fórmula que sería la gobernante durante los siguientes cuatro años. A pocos meses del arranque de la campaña presidencial 2023 todavía hay pocas definiciones de nombres. Pero nada cancela la posibilidad de que nuevamente surjan anuncios a través de las redes sociales, plataformas que llegaron para dar un sacudón al discurso político y colarse en las conversaciones de la ciudadanía. Pero, ¿qué pasa cuando las redes sociales median la conversación entre la política y la ciudadanía? ¿Se trata de una conversación entre todos o entre unos pocos?

Ya sabemos que para mantenernos informados e informadas los medios de comunicación ocupan un lugar primordial. Sin embargo, hace ya varios años que las redes sociales vienen arrasando y ocupando un lugar central en cómo nos mantenemos al día con las noticias. La necesidad de recurrir a un o una periodista para dar una primicia quedó aplastada por el micrófono que otorgaron las plataformas a los políticos y políticas que tienen miles de personas seguidoras (y detractoras) que siguen y likean de manera diaria. Un aviso, un anuncio, un clic, publicado.

El vínculo entre la política y la ciudadanía se estrechó. Este canal de comunicación directo – aunque no sin intermediarios – buscó democratizar la conversación. Llevar el mensaje de uno a todos. Es indudable que a través de las redes sociales, no solo la política le habla al pueblo, sino que ahora el pueblo le contesta, algo impensado en la prensa tradicional. En este espacio digital es donde se gesta un lugar en el que la ciudadanía participa de conversaciones con sus propios representantes. No nos olvidemos que la democracia y el respeto de los derechos fundamentales legitiman el ejercicio de poder de la ciudadanía. Y el acceso a la información es, sin dudas, un derecho fundamental en cualquier democracia como la nuestra.

A partir de esta conversación directa las personas pueden opinar con sustento e información de primera mano. Pueden llevar adelante su ejercicio democrático de la participación política en el espacio cívico. Aquí es donde el derecho a la información como un ejercicio de derecho colectivo, ya no tanto individual, cobra un carácter público o social. Según la Declaración Universal de Derechos Humanos, todo individuo tiene derecho a la libertad de opinión y expresión, incluyendo el investigar y recibir información y opiniones sin limitación de fronteras.

Visto desde este punto de vista, las redes se presentan como un espacio donde el debate democrático se da casi libremente, teniendo en cuenta que aún persisten problemas debido a la discrecionalidad con la que las plataformas moderan su contenido. Sin embargo es imposible ignorar que aún hoy en día una gran parte de la población no tiene acceso a Internet. Según un estudio de INDEC del 2021, el 64,2% de los hogares urbanos tiene acceso a una computadora y el 90,4% a internet. Esta realidad es muy diferente si se tienen en cuenta a las zonas rurales y a la totalidad del territorio argentino. Un informe del INTA y el ENACOM en 21 provincias demostró que cuatro de cada 10 parajes rurales no tienen acceso a internet y que la gran mayoría de ellos pertenece a la agricultura familiar. Además develó que mientras menos habitantes hay en una zona, menos acceso a la conectividad tiene.

Yendo un poco más allá, otro estudio privado explica que un 80% de la población argentina tiene presencia en internet. Esto significa que un 20%, casi 13 millones de personas, no tiene acceso a la web, por lo que no tiene acceso a la información distribuida por las redes y mucho menos acceso a la participación de discusiones políticas en entornos digitales. Entonces, ¿estamos hablando de una democracia digital para unos pocos o para todos?

Según las Naciones Unidas, el derecho al acceso a Internet “garantiza la conectividad, el acceso a infraestructura y a servicios servicios de las tecnologías de la información y las comunicaciones (TIC) de manera equitativa, económicamente accesible y con una calidad adecuada”. Se entiende a estas tecnologías como elementos clave en la promoción, protección y disfrute de los derechos humanos en Internet, siendo la libertad de expresión y el acceso a la información pilares fundamentales. Sin embargo queda claro que este derecho todavía no alcanza a toda la ciudadanía argentina y que es un factor de desigualdad.

Este 2023 sin dudas va a traer (y ya lo hace) anuncios políticos de distinto tono e importancia. Hoy por hoy no hay político o política argentina que no use las redes sociales como espacio de interacción directa con la ciudadanía. La militancia de la calle, cuadra por cuadra, se convirtió en la militancia digital, clic por clic. La brecha se acortó y el discurso se amplificó. Pero el acceso a Internet sigue siendo un factor de exclusión para muchos. Si los debates políticos se dan en un entorno al que no accede toda la ciudadanía en igualdad de condiciones, entonces las conversaciones se dan entre unas pocas personas.

More